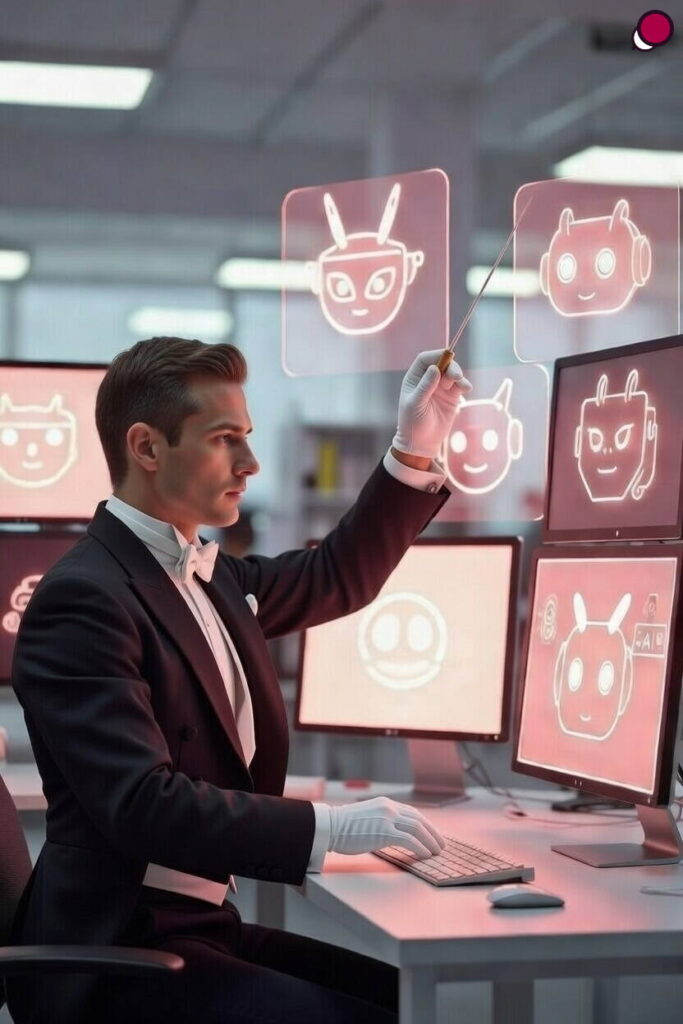

Maîtriser les agents IA : la compétence clé des prochaines années

L’intelligence artificielle a déjà quitté le stade du simple assistant conversationnel. Nous entrons dans l’ère des agents autonomes : des systèmes capables non seulement de générer du contenu, mais d’agir, planifier, exécuter des tâches et interagir avec des outils numériques sans supervision constante. Ce changement est profond. Il modifie la nature même du travail intellectuel.

Dans ce contexte, se former à l’intelligence artificielle n’est plus un avantage différenciant. C’est une compétence structurelle. Car plus les systèmes deviennent autonomes, plus la maîtrise humaine devient stratégique.

“se former à l’intelligence artificielle n’est plus un avantage différenciant. C’est une compétence structurelle.

Comprendre les agents IA : la nouvelle compétence clé du marché

Cette distinction est fondamentale. Les agents IA combinent modèle de langage, mémoire, outils externes et capacité de planification. Ils peuvent gérer des emails, déclencher des actions via API, automatiser des workflows, analyser des documents, voire piloter des environnements numériques.

Se former à l’intelligence artificielle aujourd’hui signifie comprendre cette architecture : comment un agent raisonne, comment il segmente une tâche, comment il choisit ses actions, quelles sont ses limites. Sans cette compréhension, l’illusion de contrôle est totale alors que la logique interne du système reste opaque.

Les organisations qui maîtrisent ces mécanismes ne se contentent pas d’utiliser l’IA. Elles la structurent. Elles définissent des règles, des garde-fous, des niveaux de validation. Elles savent quand déléguer et quand reprendre la main. Cette capacité devient un avantage concurrentiel réel.

Maîtriser les agents pour éviter l’automatisation aveugle

“Un chatbot répond. Un agent agit.

L’enthousiasme technologique masque parfois une réalité plus complexe : un agent autonome peut exécuter des actions irréversibles. Publier, supprimer, transférer, valider. L’automatisation mal calibrée ne ralentit pas l’erreur, elle l’accélère.

Se former à l’intelligence artificielle, c’est apprendre à concevoir des systèmes responsables. Cela implique de comprendre les risques de biais, les hallucinations des modèles, les failles de sécurité, les injections de prompts. Cela suppose aussi de savoir segmenter les droits d’accès et limiter les périmètres d’action.

L’enjeu n’est pas de freiner l’innovation, mais d’éviter que la puissance technologique ne dépasse la maturité organisationnelle. Plus un agent est autonome, plus la compétence humaine en amont doit être élevée. L’autonomie n’exclut pas la gouvernance ; elle la rend indispensable.